딥페이크(Deep Fake) 범죄에 대한 경각심이 높아지고 있는 가운데, 딥페이크를 이용한 위성 사진 또한 위협이 될 수 있다고 더버지가 보도했다.

딥페이크는 인공지능(AI) 기술 중 하나인 딥러닝(Deep Learning)을 통해 생성한 가짜 이미지 또는 영상물을 의미한다. 진위여부를 구별하기 어려울 정도로 실제처럼 보이지만, 실제론 인공지능을 통해 조작된 가짜 비디오, 사진, 오디오 등을 의미한다.

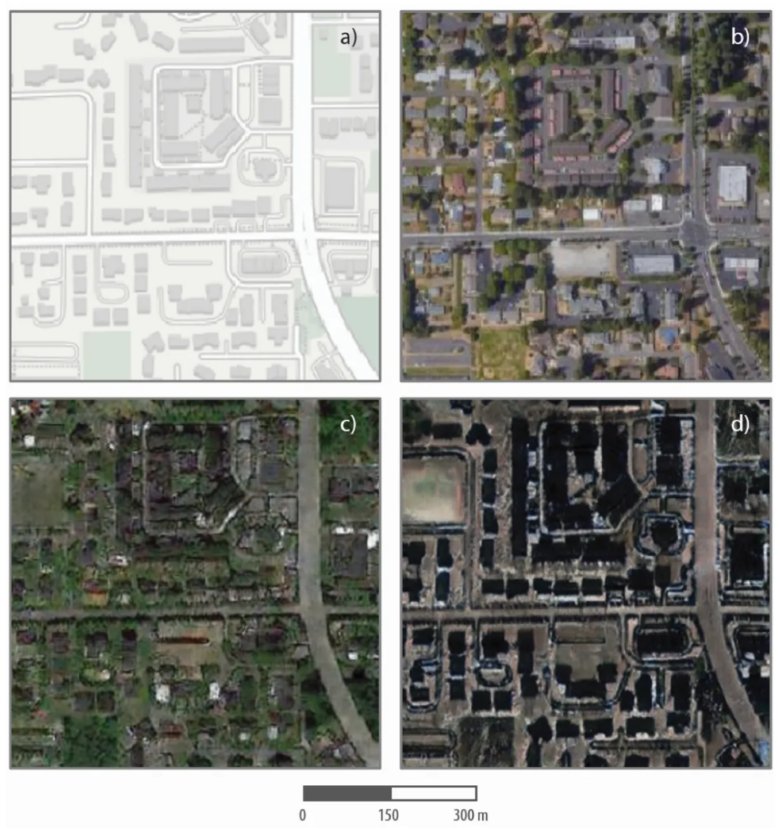

워싱턴 대학교 주도의 연구원들은 딥페이크로 조작된 영상을 탐지하기 위해 딥페이크 위성 사진을 생성하는 방법을 개발했다. 연구팀은 학습된 위성 영상의 특성을 서로 다른 기본 지도에 주입해 가짜를 생성하는 AI 알고리즘을 사용했다.

예를 들어 타코마의 도로와 건물 위치(사진 오른쪽 위)를 사용하지만, 베이징의 더 높은 건물(오른쪽 아래)이나 시애틀의 낮은 건물(왼쪽 아래)을 겹쳐서 배치할 수 있다. 조경 식물을 추가할 수도 있다. 생성된 결과물은 완벽하지는 않지만, 딥페이크 비디오를 만드는 것보다 딥페이크 위성사진을 만드는 것이 훨씬 쉽다. 사진에서 어색한 부분을 낮은 화질의 탓으로 돌릴 수 있기 때문이다.

수석 저자인 보 자오(Bo Zhao)는 "대부분의 위성 이미지는 전문가나 정부에 의해 만들어지기 때문에, 대중들은 보통 그것이 진짜라고 믿고 싶어할 것입니다."고 말했다.

보 자오는 가짜 위성 스냅샷을 긍정적으로 사용할 수 있다고 밝혔다. 과거의 위치를 시뮬레이션해 기후 변화를 이해하고, 도시의 무분별한 확장을 연구하거나, 빈 곳을 채워 지역의 진화를 예측할 수도 있다.

하지만 인공지능으로 생성한 가짜 이미지가 잘못된 정보에 사용될 가능성도 존재한다. 이러한 사진은 다양한 방법으로 오도될 수 있다. 예를 들어 산불이나 홍수에 대한 가짜 뉴스가 퍼지거나, 실제 위성사진을 바탕으로 한 이야기들을 불신하는 데 사용될 수 있다.

적대적인 국가가 군사 전략가들을 오도하기 위해 위조된 이미지를 보내, 그들이 귀중한 목표가 될 수 있는 건물이나 다리가 없어진 것을 알아차리지 못할 수도 있다. 가짜 위성사진이 국가 안보 문제로 이어질 수 있는 것이다.

또 딥페이크 이미지가 잔학 행위의 증거를 숨기거나 기후 과학을 억압하는 것과 같은 정치적 목적에 사용될 수 있다.

초기 딥페이크 기술이 학계에서 나와 실제 세상에서 쓰이는 데 오래 걸리지 않은 것처럼, 인공위성 딥페이크가 퍼지는 것은 시간문제일 수 있다. 보 자오는 "만약 우리가 딥페이크에 대해 준비가 되지 않은 것을 인식하지 않는다면, 우리는 '가짜 지리' 디스토피아에 들어가게 될 위험이 있다."고 경고했다.

연구원들은 해당 연구가 인간 중심의 가짜를 발견하기 위한 초기 작업이 존재하는 것과 같은 방법으로 인공위성 딥페이크를 포착하는 시스템을 개발하는 데 도움이 되기를 바라고 있다.

[ⓒ CWN(CHANGE WITH NEWS). 무단전재-재배포 금지]

![[신명호 칼럼] 과학의 속성, 과학적 실천과 과학 공동체](https://cwn.kr/news/data/2026/04/20/p1065599396560987_185_h.png)

![넷앤드, 파트너십으로 한국 보안 우수성 알릴 것 [다국어]](https://cwn.kr/news/data/2026/03/13/p1065581137999459_473_h.jpg)